Bias gehört zu den meistdiskutierten Begriffen im Kontext moderner Künstlicher Intelligenz (KI). Gemeint sind systematische Verzerrungen in Daten, Modellen oder Entscheidungen, die dazu führen können, dass KI-Systeme bestimmte Personen oder Gruppen benachteiligen. Für Unternehmen, Gesellschaft und Politik ist Bias damit nicht nur ein technisches Problem, sondern eine zentrale ethische und strategische Herausforderung.

Was bedeutet Bias in der KI?

Der Begriff Bias beschreibt eine Voreingenommenheit oder Verzerrung. In KI-Systemen entsteht Bias, wenn Trainingsdaten nicht ausgewogen, unvollständig oder historisch geprägt sind. Da KI aus vergangenen Daten lernt, übernimmt sie bestehende gesellschaftliche Ungleichheiten oft unbewusst – und verstärkt sie im schlimmsten Fall.

Ein klassisches Beispiel: Wenn ein Recruiting-Algorithmus überwiegend mit Lebensläufen früherer Mitarbeitender trainiert wird, kann er bestimmte Geschlechter, Altersgruppen oder Bildungswege bevorzugen. Die KI entscheidet dann scheinbar objektiv, reproduziert aber alte Muster.

Ursachen von Bias

Bias kann an verschiedenen Stellen im KI-Lebenszyklus entstehen:

- Daten-Bias: Trainingsdaten sind nicht repräsentativ oder enthalten historische Diskriminierung.

- Design-Bias: Annahmen und Entscheidungen der Entwickler beeinflussen das Modell.

- Algorithmischer Bias: Bestimmte mathematische Optimierungen bevorzugen einzelne Gruppen.

- Interpretations-Bias: Ergebnisse werden falsch oder einseitig interpretiert.

Warum Bias problematisch ist

Verzerrte KI-Systeme können reale Auswirkungen haben: ungerechte Kreditentscheidungen, diskriminierende Bewerbungsverfahren oder fehlerhafte Risikoanalysen. Neben ethischen Problemen entstehen auch rechtliche und wirtschaftliche Risiken. Mit Blick auf den EU AI Act wird deutlich, dass Unternehmen künftig stärker in der Verantwortung stehen, faire und nachvollziehbare KI-Systeme einzusetzen.

Bias gefährdet zudem das Vertrauen in KI. Wenn Nutzerinnen und Nutzer Entscheidungen nicht als gerecht empfinden, sinkt die Akzeptanz – unabhängig davon, wie leistungsfähig das System technisch ist.

Wie lässt sich Bias reduzieren?

Vollständige Bias-Freiheit ist kaum erreichbar, doch es gibt wirksame Maßnahmen zur Reduktion:

- Sorgfältige Auswahl und Analyse von Trainingsdaten

- Divers zusammengesetzte Entwicklungsteams

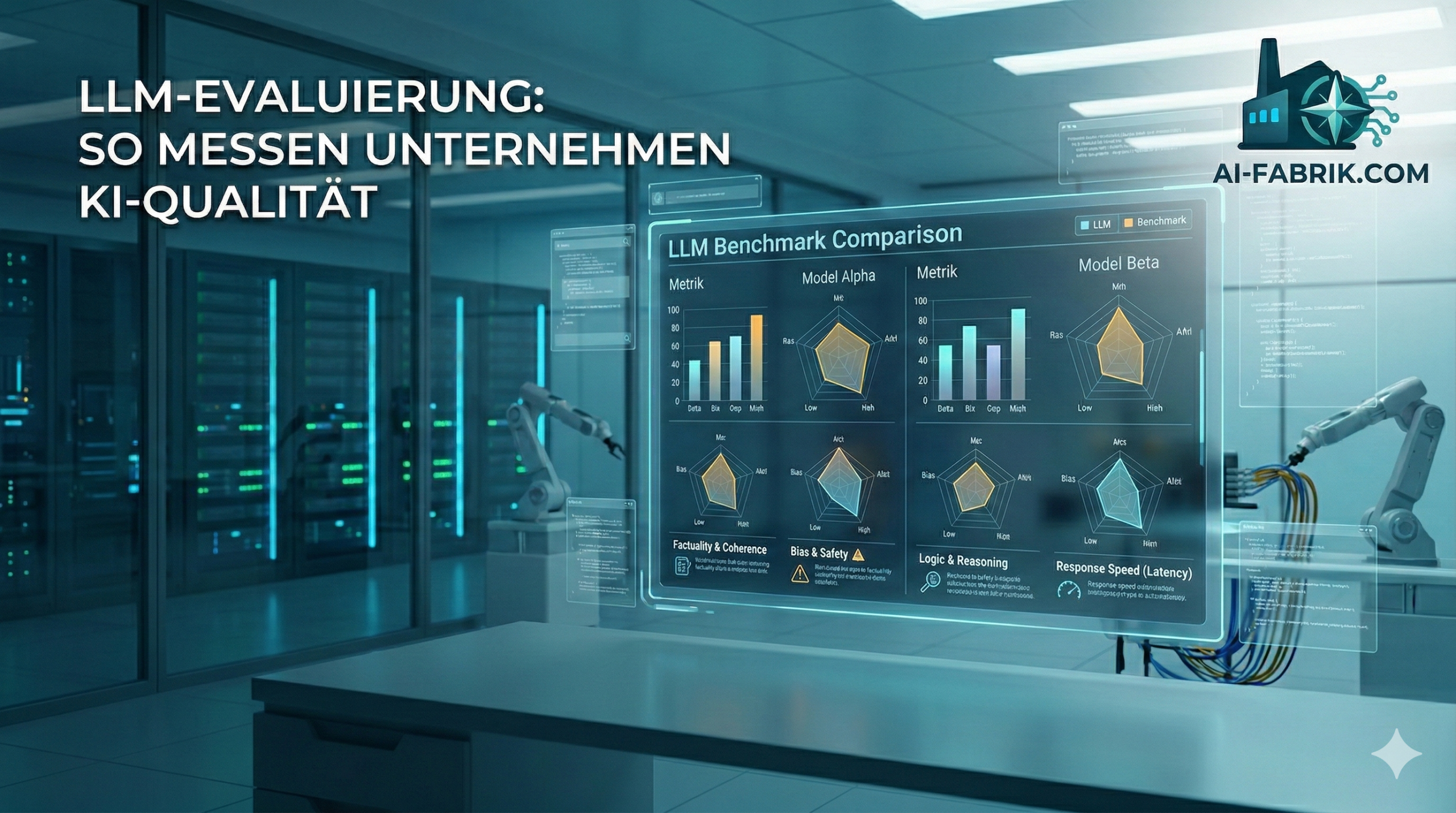

- Regelmäßige Bias-Tests und Audits

- Transparente Dokumentation von Modellen und Datenquellen

- Einsatz von Explainable AI (XAI)

Wichtig ist, Bias nicht als einmaliges Problem zu betrachten, sondern als kontinuierlichen Prozess. KI-Systeme müssen während ihres gesamten Lebenszyklus überwacht und angepasst werden.

Bias als strategisches Thema

Für Unternehmen wird Bias zunehmend zu einem Management- und Governance-Thema. Faire KI ist nicht nur eine Frage der Ethik, sondern auch der Wettbewerbsfähigkeit. Organisationen, die frühzeitig klare Richtlinien, Prüfmechanismen und Verantwortlichkeiten etablieren, verschaffen sich einen nachhaltigen Vorteil.

Die AI-Fabrik versteht Bias daher als zentrales Lernfeld moderner KI-Nutzung: zwischen technologischer Innovation, gesellschaftlicher Verantwortung und regulatorischer Sicherheit.

Fazit

Bias in der KI ist kein Randthema, sondern eine der größten Herausforderungen der digitalen Transformation. Wer KI verantwortungsvoll einsetzen will, muss Verzerrungen erkennen, verstehen und aktiv reduzieren. Nur so kann Künstliche Intelligenz ihr Potenzial entfalten – fair, transparent und vertrauenswürdig.