Dieser Artikel wurde mit Künstlicher Intelligenz erstellt und redaktionell kuratiert.

Recherchehinweis: Ausgangspunkt dieses Artikels ist die bereitgestellte AI Skills & Technologies Map. Für die Einordnung wurden Anbieterquellen, technische Dokumentationen, Studien und Governance-Quellen ausgewertet, darunter McKinsey, TÜV-Verband, IBM Think, AWS, Anthropic, OpenAI Agents SDK, NIST AI Risk Management Framework und Informationen der Europäischen Kommission zum EU AI Act.

Für Geschäftsführung und DACH-Mittelstand ist die entscheidende Frage nicht mehr: „Sollten wir KI ausprobieren?“ Die wichtigere Frage lautet: Welche KI-Kompetenzen müssen wir zuerst aufbauen, damit KI nicht in Einzelversuchen stecken bleibt?

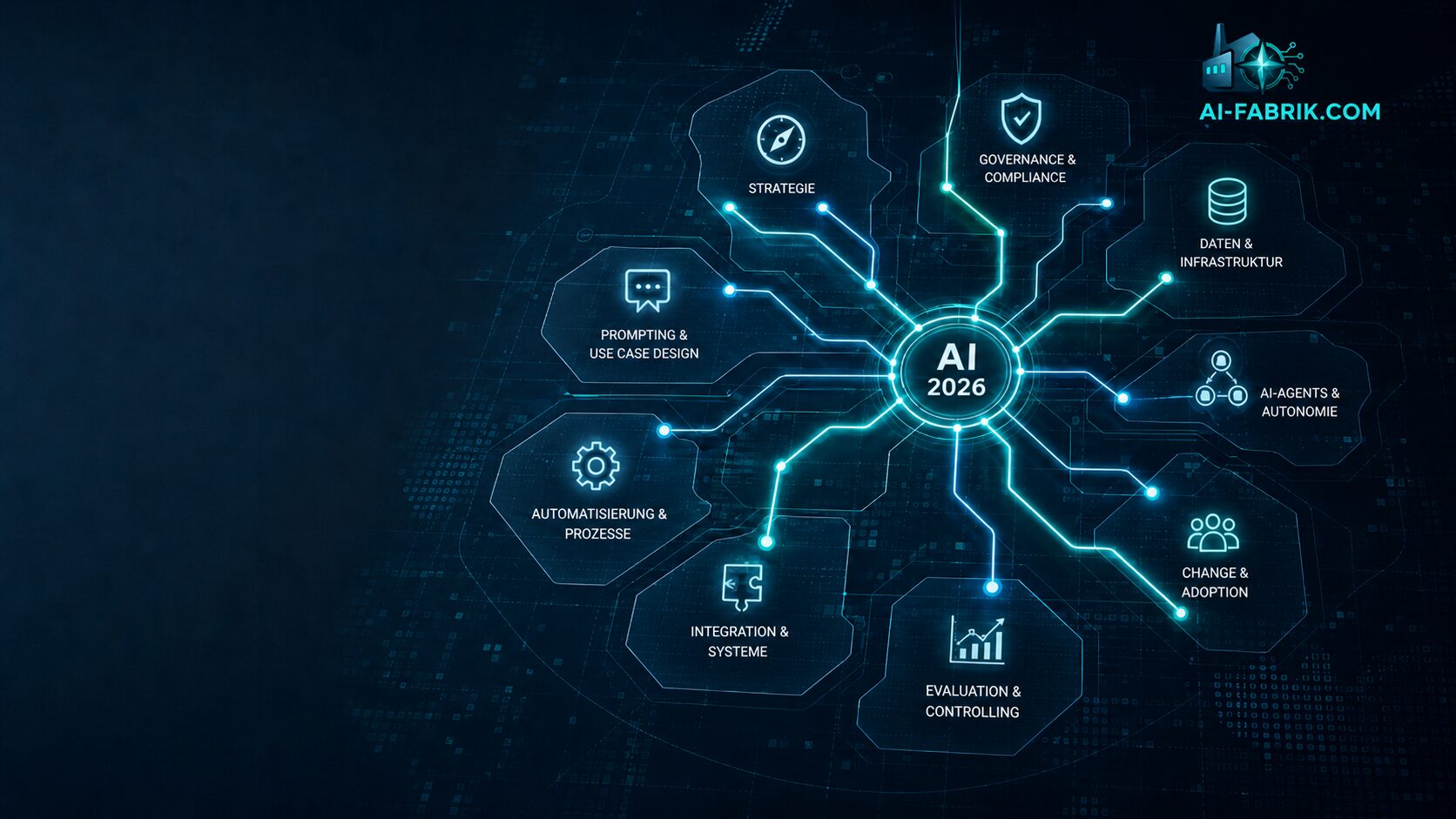

Genau hier hilft die AI Skills & Technologies Map. Auf den ersten Blick wirkt sie wie eine breite Sammlung technischer Begriffe: Machine Learning, Deep Learning, NLP, Computer Vision, Generative AI, Agentic AI, AI Agents und Governance. Mit Recherche wird daraus aber ein Reifegradmodell. Es zeigt, welche Fähigkeiten ein Unternehmen braucht, wenn aus KI-Antworten echte, kontrollierte Geschäftsprozesse werden sollen.

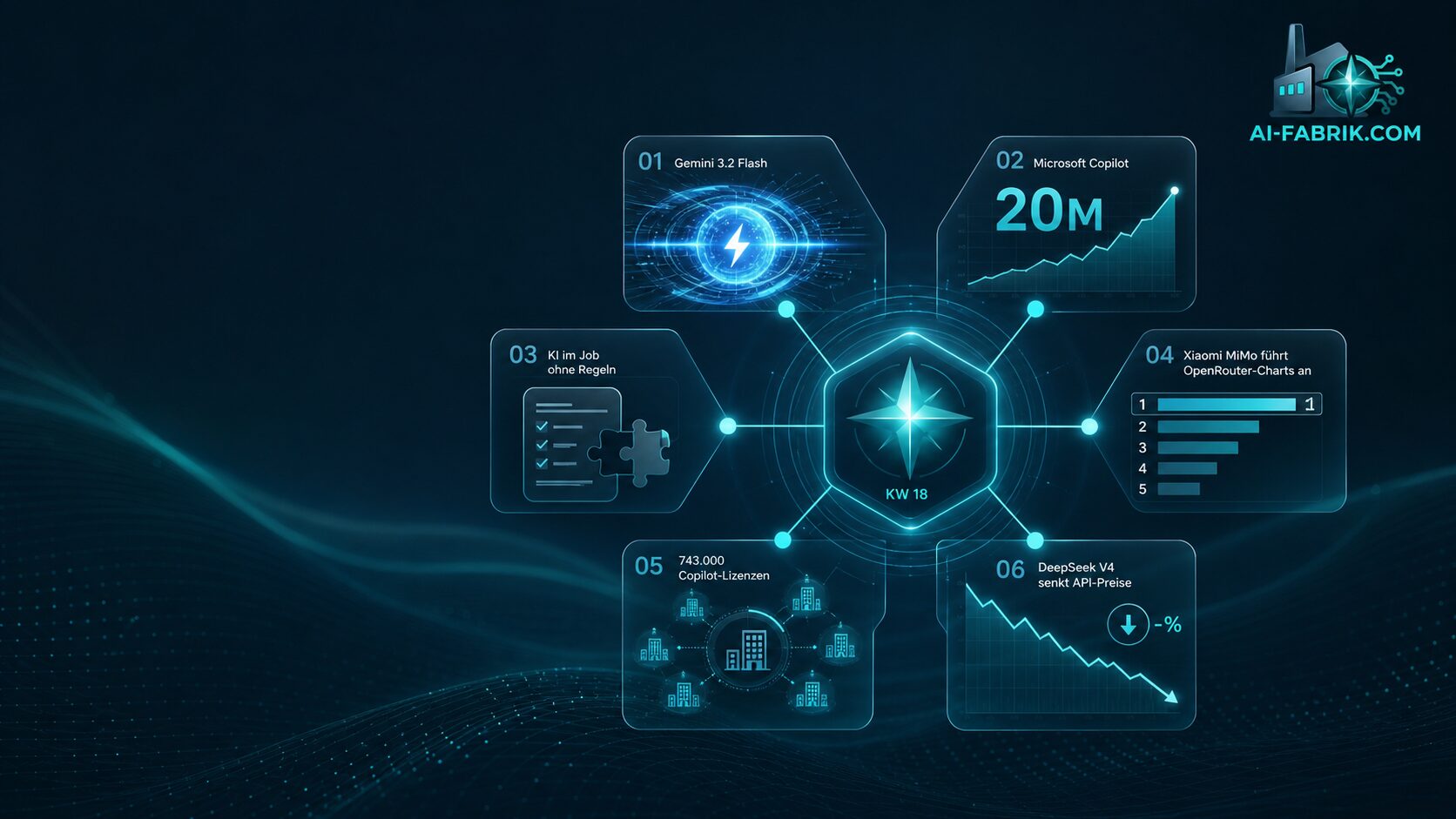

Die Zahlen zeigen den Handlungsdruck. McKinsey berichtet im State of AI 2025, dass 88 Prozent der befragten Organisationen KI regelmäßig in mindestens einer Geschäftsfunktion nutzen. Gleichzeitig haben laut McKinsey fast zwei Drittel noch nicht begonnen, KI unternehmensweit zu skalieren. Bei AI Agents ist die Lücke noch deutlicher: 62 Prozent experimentieren mindestens mit Agenten, aber nur 23 Prozent skalieren agentische Systeme irgendwo im Unternehmen. Für Deutschland zeigt der TÜV-Verband: 45 Prozent der Erwerbstätigen nutzen KI im Job, aber 54 Prozent arbeiten ohne klare Regeln oder Verbot. Genau zwischen Nutzung und Steuerung liegt die Kompetenzlücke.

⏱️ In 30 Sekunden

- KI-Kompetenzen Unternehmen 2026 bedeutet mehr als Prompting: Entscheidend sind Datenverständnis, Prozessdesign, Tool-Integration, Evaluation und Governance.

- Generative AI erstellt Inhalte. Das ist produktiv, aber noch keine belastbare Prozessautomatisierung.

- Agentic AI plant Aufgaben, nutzt Tools, prüft Zwischenergebnisse und steuert mehrstufige Abläufe.

- AI Agents sind konkrete Systeme mit Modell, APIs, Speicher, Berechtigungen, Guardrails und Protokollierung.

- Die wichtigste Priorität für DACH-Unternehmen: erst Daten- und Governance-Basis schaffen, dann agentische Workflows skalieren.

- Der Merksatz lautet: Generative AI liefert Outputs, Agentic AI steuert Abläufe, AI Agents handeln in Systemen.

Hauptzielgruppe: Geschäftsführung im DACH-Mittelstand

Dieser Artikel richtet sich primär an Geschäftsführung, Bereichsleitung und Transformationsverantwortliche in DACH-Unternehmen. Ziel ist nicht, jedes Framework technisch zu erklären. Ziel ist eine Priorisierung: Welche Kompetenzen müssen zuerst aufgebaut werden, welche folgen danach, und wo reicht interne Schulung nicht mehr aus?

Leserpfade

- Geschäftsführung: Fokus auf Prioritäten, Reifegrad, Risiken und Investitionslogik.

- IT/Data: Fokus auf Datenzugriff, RAG, APIs, Guardrails, Evaluation und Monitoring.

- Datenschutz/Betriebsrat: Fokus auf Datenklassen, Freigaben, Protokollierung und AI Literacy.

- Trainer/Berater: Fokus auf didaktische Abgrenzung und Kompetenzmatrix.

Die Map als Reifegradmodell

Ohne Priorisierung ist die Skills Map zu breit. Deshalb übersetzen wir sie in vier Reifegrade, die Unternehmen nacheinander aufbauen sollten.

| Priorität | Kompetenzfeld | Warum zuerst? | Typische Verantwortung |

|---|---|---|---|

| Jetzt | AI Literacy, Datenklassen, sichere Nutzung | KI wird bereits genutzt; ohne Regeln entstehen Datenschutz-, Qualitäts- und Haftungsrisiken. | Geschäftsführung, Datenschutz, HR, Betriebsrat |

| Jetzt | Generative AI produktiv einsetzen | Texte, Zusammenfassungen, Ideengenerierung und einfache Analysen liefern schnellen Nutzen. | Fachbereiche, L&D |

| Als Nächstes | Daten- und Kontextkompetenz: NLP, RAG, Wissensquellen | Agenten und Assistenzsysteme brauchen verlässlichen Kontext, sonst skalieren Fehler. | IT, Data, Wissensmanagement |

| Als Nächstes | Agentic AI und kontrollierte Workflows | Mehrstufige Aufgaben brauchen Planung, Tool-Grenzen, Evaluation und Freigaben. | IT/Data mit Fachbereichen |

| Später skalieren | AI Agents mit Systemzugriff | Schreibzugriffe, Tickets, CRM/ERP-Aktionen und Automatisierung brauchen Governance und Audit-Logs. | IT, Security, Fachbereich, Compliance |

Diese Reihenfolge ist bewusst konservativ. McKinsey zeigt, dass viele Organisationen KI nutzen, aber noch nicht unternehmensweit skalieren. Der Fehler wäre, diese Lücke mit möglichst autonomen Agenten zu überspringen. Der bessere Weg ist: erst Nutzung steuern, dann Datenbasis stärken, dann agentische Workflows kontrolliert einführen.

Die drei Kernbegriffe: Output, Ablauf, Handlung

Die Map unterscheidet mehrere Felder, aber für Unternehmensentscheidungen sind drei Begriffe besonders wichtig: Generative AI, Agentic AI und AI Agents.

Generative AI

Kernidee: Erstellt Inhalte.

Beispiel: „Schreibe eine Management-Zusammenfassung.“

Grenze: Kein eigenständiges Handeln in Unternehmenssystemen.

Agentic AI

Kernidee: Plant und steuert Aufgaben zielorientiert.

Beispiel: „Analysiere die Daten, priorisiere Risiken und entscheide nächste Schritte.“

Grenze: Ohne Tool-Grenzen und Evaluation entstehen schwer kontrollierbare Abläufe.

AI Agent

Kernidee: Führt Aufgaben als konkretes System mit Tools aus.

Beispiel: „Erstelle ein Ticket, aktualisiere den Status und dokumentiere den Vorgang.“

Grenze: Systemzugriff braucht Rechte, Freigaben, Logging und Verantwortung.

Warum Agentic AI der Übergangspunkt ist

IBM und AWS beschreiben Agentic AI als zielorientierte Systeme, die Autonomie, Planung und Tool-Nutzung verbinden. Anthropic unterscheidet zusätzlich zwischen vorhersehbaren Workflows und echten Agents, die ihre Schritte dynamisch steuern. Genau diese Unterscheidung ist für Unternehmen entscheidend.

Nicht jede Aufgabe braucht einen Agenten. Viele Aufgaben sind mit klaren Workflows besser gelöst: Eingabe prüfen, Kontext abrufen, Antwort erzeugen, Ergebnis validieren, Freigabe einholen. Agenten werden dort interessant, wo der Lösungsweg nicht vollständig vorhersehbar ist und das System unterwegs Entscheidungen treffen muss.

OpenAI stellt in seinen Agents-Dokumentationen deshalb nicht nur Modellzugriff, sondern Orchestrierung, Guardrails, Tracing und Evaluation in den Mittelpunkt. In der Praxis heißt das: Ein Agent ist kein Chatfenster mit mehr Mut. Ein Agent ist ein System, dessen Aktionen beobachtbar, begrenzt und überprüfbar sein müssen.

Praxisbeispiel: Vertriebsdaten bereinigen

Nehmen wir eine Vertriebsabteilung. Jeden Monat kommt eine Excel-Datei mit Kundendaten, offenen Angeboten und Statusfeldern. Die Datei enthält Dubletten, uneinheitliche Schreibweisen und fehlende Werte. Das ist kein spektakulärer KI-Use-Case, aber ein guter Test für echte Unternehmensreife.

| Ebene | Was passiert? | Ergebnis |

|---|---|---|

| Generative AI | Erklärt mögliche Probleme und schlägt Bereinigungsschritte vor. | Text, Formelidee oder Code-Vorschlag |

| Agentic AI | Prüft Spaltenstruktur, erkennt Dubletten, priorisiert Fehler und plant nächste Schritte. | Mehrstufiger Analyse- und Aktionsplan |

| AI Agent | Lädt eine Kopie, erstellt eine Vorschau, nutzt Tools, wartet auf Freigabe und speichert die bereinigte Version. | Kontrolliert geänderte Datei plus Protokoll |

Der entscheidende Punkt: Der Agent arbeitet nicht still im Original. Er braucht Vorschau, Änderungsliste, Freigabe und Audit-Log. Genau hier zeigt sich, ob ein Unternehmen nur KI ausprobiert oder bereits KI-Prozesse gestaltet.

✅ Merksatz für Unternehmen

Generative AI ist der Autor. Agentic AI ist der Projektleiter. Der AI Agent ist der Mitarbeiter mit Werkzeugkasten und Zugriffsrechten.

Oder noch kürzer: Agentic AI ist das Prinzip, AI Agent ist das Produkt.

Die Kompetenzmatrix für 2026

Wer aus der Map ein Schulungs- und Umsetzungsprogramm ableiten will, sollte nicht alle Skills gleich behandeln. Die folgende Matrix priorisiert nach Rolle.

| Rolle | Priorität 1 | Priorität 2 | Nicht zuerst |

|---|---|---|---|

| Geschäftsführung | Use-Case-Priorisierung, Risiken, Verantwortlichkeiten | Budget, Reifegrad, Erfolgsmessung | Framework-Details |

| Fachbereiche | Aufgabenformulierung, Output-Prüfung, Datenklassen | Use Cases als Prozess beschreiben | Agenten-Frameworks konfigurieren |

| IT/Data | Datenzugriff, RAG, APIs, Monitoring | Guardrails, Evaluation, Tool-Dokumentation | Unkontrollierte Autonomie |

| Datenschutz/Betriebsrat | Richtlinien, Freigaben, Protokollierung | AI Literacy, DSFA-Prüfung, Rollenrechte | Nachträgliche Prüfung fertiger Agenten |

| Trainer/L&D | AI Literacy und sichere Nutzung | Rollenbasierte Lernpfade | Einheitskurs für alle |

Diese Matrix schärft den Suchintent des Artikels: Es geht nicht darum, alle KI-Technologien gleich tief zu erklären. Es geht darum, die Skills Map in eine Prioritätenliste für Unternehmen zu übersetzen.

DACH-Einordnung: Die Nutzung ist schneller als die Steuerung

Die TÜV-Zahlen machen die DACH-Relevanz greifbar: 45 Prozent der Erwerbstätigen nutzen KI im Job, aber 54 Prozent berichten von weder Regeln noch Verbot. Nur 38 Prozent der beruflichen KI-Nutzenden haben sich dafür weitergebildet. Das ist genau die Lücke, die die Skills Map adressiert: Nutzung ist vorhanden, Kompetenz und Governance hinken hinterher.

Artikel 4 des EU AI Act verstärkt diese Perspektive. Anbieter und Betreiber von KI-Systemen sollen für ein ausreichendes Maß an KI-Kompetenz bei Personen sorgen, die mit KI-Systemen arbeiten. Für Unternehmen bedeutet das: AI Literacy ist kein Nice-to-have, sondern Teil der Umsetzungsverantwortung. Eine Prompting-Schulung allein reicht nicht, wenn Mitarbeitende mit Kundendaten, internen Dokumenten oder agentischen Workflows arbeiten.

Risiken: Wo aus Komfort Verantwortung wird

Je mehr ein KI-System handeln darf, desto wichtiger werden Kontrolle und Nachvollziehbarkeit. Bei Generative AI geht es häufig um Qualität, Urheberrecht, Datenschutz und Halluzinationen. Bei Agentic AI und AI Agents kommen operative Risiken hinzu.

⚠️ Typische Risiken bei AI Agents

- falsche Tool-Auswahl

- ungewollte Datenänderungen

- fehlende Berechtigungsgrenzen

- schwer nachvollziehbare Entscheidungsketten

- Fehlerfortpflanzung über mehrere Systeme

- unklare Verantwortung bei automatisierten Aktionen

- zu viel Framework-Komplexität ohne messbaren Nutzen

Deshalb sollten Unternehmen Agenten nicht nur nach Modellqualität bewerten. Mindestens genauso wichtig sind Rollenmodell, Logging, Freigaben, Testumgebung, Zugriffskontrolle, Guardrails und Not-Aus-Mechanismen. Mehr zur Governance-Perspektive findet sich im AI-Fabrik-Artikel zu Microsoft Agent 365.

Checkliste: Der nächste Schritt in 30 Tagen

- Eine Hauptzielgruppe festlegen: Starten Sie nicht mit „alle Mitarbeitenden“, sondern mit einem Fachbereich und einem klaren Prozess.

- KI-Nutzung sichtbar machen: Welche Tools werden bereits genutzt? Welche Daten landen dort?

- Datenklassen definieren: Was darf in KI-Systeme, was nur anonymisiert, was gar nicht?

- Eine Kompetenzmatrix bauen: Fachbereich, IT, Management und Datenschutz brauchen unterschiedliche Lernziele.

- Einen risikoarmen Pilotprozess auswählen: Kopien statt Originaldaten, Vorschau statt Blindflug.

- Freigaben und Logging festlegen: Jede Systemaktion braucht Nachvollziehbarkeit.

- Nach 30 Tagen messen: Zeitersparnis, Fehlerquote, Nachbearbeitung, Akzeptanz und Datenschutzvorfälle prüfen.

Häufige Fragen zur AI Skills & Technologies Map

Welche KI-Kompetenzen brauchen Unternehmen 2026 zuerst?

Zuerst brauchen Unternehmen AI Literacy, klare Datenregeln, sichere Nutzung generativer KI und eine Use-Case-Priorisierung. Danach folgen Daten-/RAG-Kompetenz, kontrollierte Workflows und erst anschließend AI Agents mit Systemzugriff.

Warum reicht Prompting allein nicht mehr aus?

Prompting verbessert einzelne Interaktionen. Unternehmen brauchen aber wiederholbare Abläufe. Sobald KI mit Datenquellen, Tools und Freigaben arbeitet, werden Prozessdesign, Berechtigungen, Evaluation und Governance wichtiger als die perfekte Formulierung eines einzelnen Prompts.

Was ist der Unterschied zwischen Agentic AI und AI Agents?

Agentic AI beschreibt das Prinzip: Ein System verfolgt ein Ziel, plant Schritte und passt sich an neue Informationen an. AI Agents sind die konkrete Umsetzung: ein Modell plus Tools, APIs, Speicher, Rollen, Regeln und Protokollierung.

Sollten KMU eigene KI-Agenten bauen?

Nicht sofort in großem Stil. Für viele KMU ist ein kleiner, kontrollierter Pilot sinnvoller: ein abgegrenzter Prozess, Kopien statt Originaldaten, menschliche Freigabe und sichtbares Protokoll. Erst wenn Nutzen und Risiken verstanden sind, lohnt sich Skalierung.

Fazit: Erst Kompetenzmatrix, dann Agent

Die AI Skills & Technologies Map zeigt keine Einkaufsliste für Tools. Sie zeigt eine Reihenfolge. Unternehmen sollten 2026 nicht mit dem autonomsten Agenten beginnen, sondern mit einer ehrlichen Kompetenzmatrix: Wer darf KI wofür nutzen? Welche Daten sind erlaubt? Welche Prozesse eignen sich für Automatisierung? Wer prüft Ergebnisse? Wer trägt Verantwortung?

Der nächste konkrete Schritt: Wählen Sie einen Fachbereich, einen wiederkehrenden Prozess und eine kleine Pilotgruppe. Erstellen Sie dafür innerhalb von 30 Tagen eine Rollen- und Kompetenzmatrix. Erst wenn diese Basis steht, lohnt sich der nächste Schritt in Richtung Agentic AI und AI Agents.

Weiterführende Artikel auf AI-Fabrik

- Generative AI, Agentic AI und AI Agents: Der Unterschied einfach erklärt

- KI-Agent aufbauen: 8 Bausteine für Ihr Unternehmen

- RAG-Architektur 2026: Der Engpass ist nicht das Modell

- Microsoft Agent 365: Startpartner bestätigt vor dem Launch am 1. Mai

- KI im Job: Fast jeder zweite Erwerbstätige nutzt KI – ohne Regeln

Quellen

- McKinsey: The State of AI: Global Survey 2025

- TÜV-Verband: Fast jeder zweite Erwerbstätige nutzt Künstliche Intelligenz im Job

- IBM Think: What is generative AI?

- IBM Think: What is agentic AI?

- IBM Think: What are AI agents?

- IBM Think: The evolving ethics and governance landscape of agentic AI

- AWS: What is Agentic AI?

- Anthropic Engineering: Building effective agents

- OpenAI Docs: Agents SDK

- OpenAI Agents SDK: Guardrails

- NIST: AI Risk Management Framework

- Europäische Kommission: AI Literacy – Questions & Answers

- AI Act Service Desk: Article 4: AI literacy