Dieser Artikel wurde mit Künstlicher Intelligenz erstellt und redaktionell kuratiert. Quellenstand: 6. Mai 2026.

⚡ In 30 Sekunden

- Microsofts KI-Portfolio 2026: fünf Schichten – von Copilot für Anwender bis Foundry für Entwickler.

- M365 Copilot: 18,20 € netto/Nutzer/Monat (Business); Aktionspreis bis 30.06.2026: 15,60 €.

- Copilot Studio und Agent 365 ermöglichen steuerbare, verwaltbare Agenten – über Chat hinaus.

- GitHub Copilot Business: 19 USD/Nutzer/Monat – ab Juni 2026 token-basiert abgerechnet.

- DACH-Pflichtcheck: AVV (Art. 28 DSGVO), DSFA (Art. 35), BetrVG §87, EU AI Act Art. 4.

- Fazit: Nicht Lizenz zuerst – Architektur, Daten und Governance zuerst.

👤 Für wen ist dieser Artikel?

CIOs & IT-Entscheider: Portfolio-Logik, Architektur und Lizenzfragen. Fachbereiche: welcher Copilot- oder Agentenbaustein für welche Arbeit sinnvoll ist. Datenschutz, Compliance & Betriebsrat: Datenzugriff, Logging, EU AI Act, DSGVO und Mitbestimmung.

Warum dieser Überblick 2026 wichtig ist

Wer glaubt, Microsofts KI-Angebot mit dem Kauf einer „Copilot-Lizenz" zusammenzufassen, fragt inzwischen zu klein. Laut Microsoft-Daten nutzen mehr als 90 Prozent der Fortune-500-Unternehmen Microsoft 365 Copilot – doch hinter dieser einen Zahl verbergen sich mindestens zehn unterschiedliche Produkte, drei Preismodelle und ein komplexes Geflecht aus Datenschutz-, Governance- und Mitbestimmungsfragen. Für DACH-Unternehmen bedeutet das: Nicht der Rollout ist die schwierigste Aufgabe, sondern die Architekturentscheidung davor.

2026 reicht Microsofts KI-Portfolio vom Consumer-Copilot über Microsoft 365 Copilot, GitHub Copilot und Security Copilot bis zu Copilot Studio, Agent 365, Azure AI Foundry, Dynamics 365, Power Platform, Fabric und Copilot+ PCs. Wer nur einen Ausschnitt davon kennt, riskiert falsche Budgeterwartungen, blinde Flecken bei der Governance und Probleme mit Datenschutzbehörden oder dem Betriebsrat.

Executive Summary: Microsoft baut KI als Unternehmensschicht

Microsofts KI-Portfolio 2026 sollte nicht als Einkaufsliste verstanden werden. Microsoft 365 Copilot ist dabei laut Microsoft nur die sichtbare Oberfläche. Darunter liegen Copilot Studio für eigene Agenten, Agent 365 für Governance, Azure AI Foundry für Modell- und Plattformbetrieb, GitHub Copilot für Entwicklung, Security Copilot für Verteidigung, Dynamics 365 und Power Platform für Geschäftsprozesse sowie Fabric für Datenanalyse.

Für DACH-Unternehmen entsteht daraus ein klarer Startpunkt: Erst die Arbeits- und Datenräume ordnen, dann die passenden KI-Bausteine auswählen. Wer heute mit Copilot startet, sollte nicht nur Prompt-Schulungen planen, sondern auch Berechtigungen, Datenklassen, Betriebsrat, AVV/DPA-Unterlagen, Drittlandtransfer, Logging, Kostenkontrolle und menschliche Freigaben prüfen.

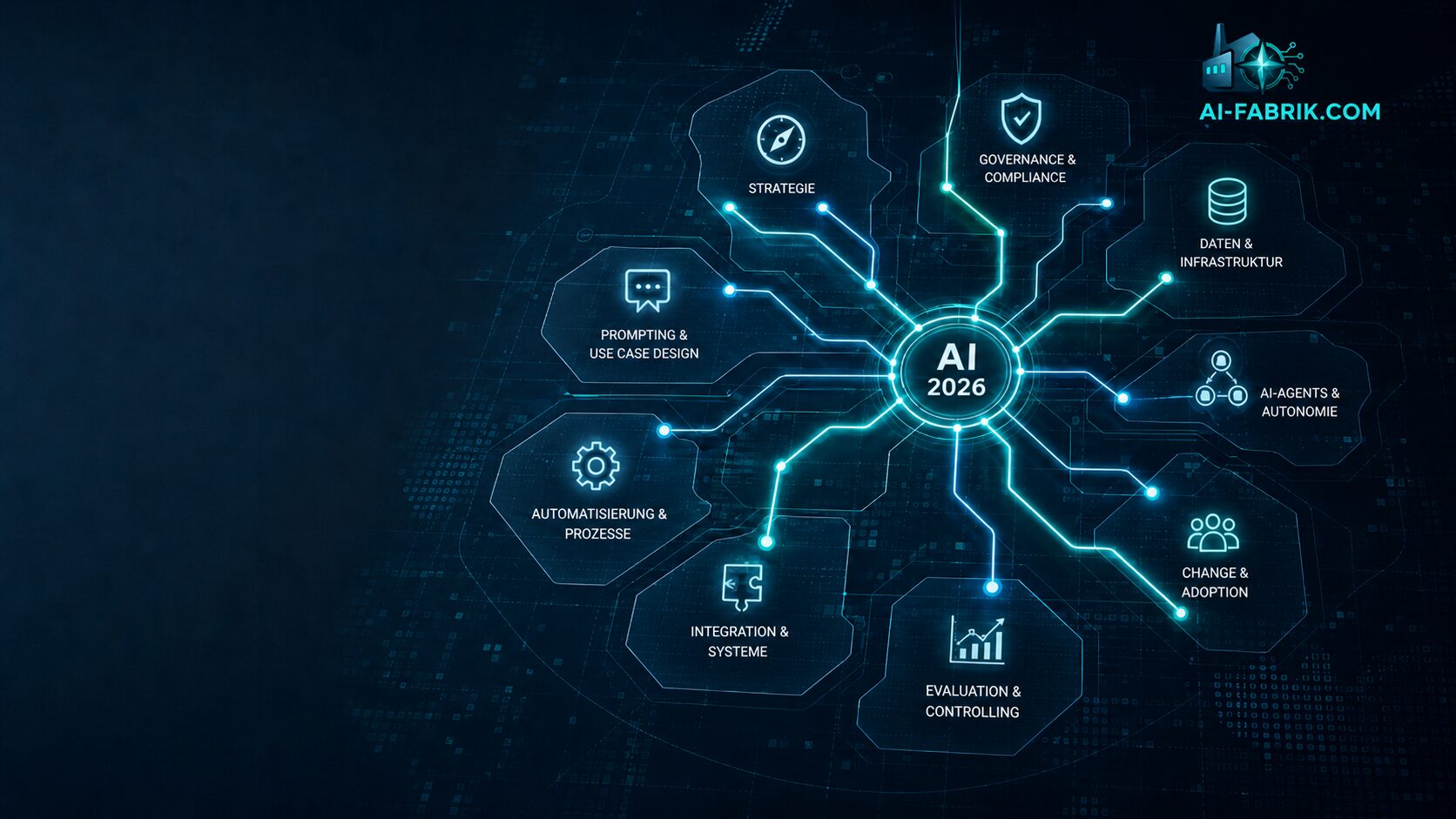

Die Portfolio-Logik: Fünf Schichten, ein System

Das folgende Schichtenmodell zeigt, wie Microsofts KI-Bausteine zusammenhängen – von der Anwenderoberfläche bis zur technischen Plattform. Jede Schicht adressiert andere Entscheidungsträger und stellt andere Anforderungen an Governance und Betrieb.

Merksatz

Microsofts KI-Portfolio ist kein einzelner Assistent. Es ist eine KI-Schicht über Microsoft 365, Azure, GitHub, Security, Business Apps, Datenplattform und Windows.

| Schicht | Microsoft-Bausteine | Typische Unternehmensfrage |

|---|---|---|

| 1 · Anwender-KI | Microsoft 365 Copilot, Copilot Chat, Copilot in Windows, Copilot+ PCs | Wie helfen wir Mitarbeitenden beim Schreiben, Suchen, Zusammenfassen und Entscheiden? |

| 2 · Fachbereichs-KI | Dynamics 365 Copilot, Security Copilot, Fabric, Power BI | Wo soll KI direkt in konkrete Arbeitsprozesse eingebettet werden? |

| 3 · Agenten | Copilot Studio, Agent Builder, Researcher, Analyst, SharePoint Agents, Agent 365 | Welche Aufgaben dürfen KI-Systeme über mehrere Schritte hinweg erledigen? |

| 4 · Entwickler- und Plattform-KI | GitHub Copilot, Azure AI Foundry, Azure OpenAI, Foundry Models | Wie bauen, testen und betreiben wir eigene KI-Anwendungen und Agenten? |

| 5 · Governance und Betrieb | Entra, Purview, Intune, Defender, Sentinel, Agent 365 | Wie kontrollieren wir Zugriff, Datenabfluss, Kosten, Logs, Risiken und Compliance? |

Microsoft 365 Copilot: Die Oberfläche für Wissensarbeit

Microsoft 365 Copilot ist für viele Organisationen der sichtbarste Einstieg. Laut Microsoft arbeitet Copilot in Word, Excel, PowerPoint, Outlook, Teams, Loop, OneNote, Forms und Whiteboard. Antworten können mit Webinformationen und Arbeitsinhalten kombiniert werden, auf die ein Nutzer bereits Zugriff hat. Der Kontext kommt unter anderem aus Microsoft Graph: E-Mails, Chats, Dateien, Meetings und Organisationsdaten.

Der Mehrwert liegt im Arbeitskontext. Ein Mitarbeitender kann eine E-Mail-Kette zusammenfassen, eine Präsentation aus einem Word-Dokument vorbereiten, ein Meeting in Teams nachbereiten, Excel-Daten analysieren oder in OneDrive mehrere Dateien vergleichen. Genau deshalb gehört vor einen breiten Rollout fast immer eine Berechtigungs- und Datenhygiene – wer Copilot aktiviert, ohne SharePoint-Freigaben zu bereinigen, riskiert laut Sicherheitsexperten, dass sensible Inhalte für mehr Mitarbeitende sichtbar werden als beabsichtigt.

Copilot Studio und Agent 365: Von Chat zu Handlung

Copilot Studio ist laut Microsoft die Low-Code- und SaaS-Plattform, um eigene Copilots und Agenten zu erstellen, anzupassen, zu veröffentlichen und zu verwalten. Unternehmen können Agenten mit Unternehmenswissen verbinden, Aktionen einbinden, Workflows ausführen und sie in Microsoft 365, Teams, Websites oder anderen Oberflächen bereitstellen.

Agent 365 bezeichnet Microsoft als zentralen Governance-Baustein – eine Control Plane für KI-Agenten. Laut Microsoft-Ankündigung befindet sich Agent 365 (Stand Mai 2026) in der schrittweisen Einführung für Enterprise-Kunden; die allgemeine Verfügbarkeit ist für das zweite Halbjahr 2026 geplant. Dahinter steht eine einfache Annahme: Wenn Unternehmen viele Agenten einsetzen, brauchen sie ein Inventar, Identitäten, Zugriffskontrolle, Sicherheitsrichtlinien, Monitoring, Lebenszyklusmanagement und Auditierbarkeit.

⚠️ Governance-Hinweis

- Identität: Jeder Agent braucht Zweck, Eigentümer und nachvollziehbare Rechte.

- Datenzugriff: Ein Agent darf nicht mehr sehen als sein Use Case wirklich braucht.

- Handlungsrechte: Schreiben, Löschen, Versenden oder Ticket-Schließen braucht Freigaben.

- Kontrolle: Logging, Verantwortliche, Lebenszyklus und Not-Aus gehören vor den Rollout.

Azure AI Foundry, GitHub Copilot und Security Copilot

Azure AI Foundry ist laut Microsoft die technische Plattform für Unternehmen und Entwickler, die eigene KI-Anwendungen, Modelle und Agenten bauen wollen. Während Microsoft 365 Copilot vor allem die fertige Arbeitsoberfläche ist, beantwortet Foundry Fragen zu Modellwahl, Datenanbindung, Evaluation, Deployment und Betrieb.

GitHub Copilot ist laut Microsoft das KI-Angebot für Entwicklungsteams. Es umfasst Code-Vervollständigung, Chat, Pull-Request-Unterstützung und zunehmend agentische Funktionen. Ab dem 1. Juni 2026 stellt GitHub laut eigener Ankündigung auf nutzungsbasierte Abrechnung um: Statt fixer Premium-Anfragen werden Token-basierte „AI Credits" abgerechnet. Der Grundpreis bleibt bei 19 USD/Nutzer/Monat (Business) bzw. 39 USD/Nutzer/Monat (Enterprise). Trotz Produktivitätsgewinn bleiben Code Reviews, Security Scans, Lizenzprüfung, Testabdeckung und Architekturverantwortung Pflicht.

Microsoft Security Copilot unterstützt laut Microsoft Security- und IT-Teams bei Incident Response, Threat Hunting, KQL-Abfragen, Skriptanalyse und Posture Management. In DACH-Unternehmen muss besonders klar geregelt werden, wann Copilot nur berät und wann Aktionen automatisiert werden dürfen – das berührt unmittelbar die Betriebsvereinbarungen nach BetrVG §87.

Preise und Lizenzlogik (Stand: Mai 2026)

Die Lizenzkosten sind nur ein Teil der Gesamtrechnung – aber sie sind konkret planbar. Microsoft 365 Copilot kostet laut Microsoft als Add-on 18,20 € netto/Nutzer/Monat (Business, bis 300 Nutzer) bzw. ca. 26,00 € netto/Nutzer/Monat (Enterprise) – zuzüglich der jeweiligen Basislizenz (z. B. M365 Business Standard: 12,50 €/Nutzer/Monat, steigt ab 1. Juli 2026 auf 14,00 €). Bis zum 30. Juni 2026 gilt ein Aktionspreis von 15,60 €/Nutzer/Monat (Business). GitHub Copilot Business kostet laut GitHub-Dokumentation 19 USD/Nutzer/Monat als Basislizenz; ab Juni 2026 kommen token-abhängige AI-Credit-Kosten hinzu.

| Kostenart | Beispiele & Orientierungspreise (netto, zzgl. MwSt.) | Steuerungsfrage |

|---|---|---|

| Nutzerlizenzen | M365 Copilot Business: 18,20 €/Nutzer/Monat (Aktionspreis bis 30.06.2026: 15,60 €); Enterprise: ca. 26,00 €; GitHub Copilot Business: 19 USD/Nutzer/Monat | Welche Rollen brauchen dauerhaft Zugriff? |

| Verbrauch und Kapazität | Azure AI Foundry, Modellaufrufe (Token-basiert), Copilot Studio, Fabric; GitHub Copilot ab Juni 2026: AI-Credits-Modell – Budgetobergrenze pro Nutzer einrichten | Welche Use Cases skalieren mit Tokens, Aktionen oder Datenvolumen? |

| Betrieb und Governance | Schulung, Datenbereinigung, Monitoring, Datenschutzprüfung, Betriebsrat – erfahrungsgemäß 40–60 % der Gesamtinvestition | Welche Kosten entstehen, damit KI sicher und produktiv genutzt wird? |

DACH-Perspektive: Compliance und Betriebsmodell zuerst

Für deutsche, österreichische und schweizerische Unternehmen liegt die größte Gefahr in einer zu einfachen Einführungserzählung. „Wir kaufen Copilot-Lizenzen" klingt handhabbar. Tatsächlich berührt Microsofts KI-Portfolio Identitätsmanagement, Dokumentenablage, Security, Datenschutz, Fachprozesse, Trainings, Kostenmodelle und Change Management – und das unter einem strengen Regulierungsrahmen.

⚖️ Rechtlicher Rahmen für DACH-Unternehmen

- Art. 28 DSGVO (Auftragsverarbeitung): Vor dem Einsatz von Microsoft Copilot ist ein Auftragsverarbeitungsvertrag (AVV/DPA) mit Microsoft zu schließen. Prüfen Sie, ob Microsofts EU Data Boundary gilt und ob Subprozessoren in Drittländern akzeptabel sind.

- Art. 35 DSGVO (Datenschutz-Folgenabschätzung): Bei großflächigem Copilot-Einsatz, insbesondere mit agentischen Funktionen und Zugriff auf personenbezogene Daten, ist eine DSFA (DPIA) sehr wahrscheinlich erforderlich.

- BetrVG §87 (Mitbestimmung): Nutzungsdaten, Leistungsüberwachung und neue KI-gestützte Arbeitsweisen können mitbestimmungspflichtig sein. Der Betriebsrat sollte frühzeitig eingebunden werden – nicht erst bei der Einführung.

- EU AI Act (Anhang III / Art. 6): Microsoft 365 Copilot gilt als GPAI-System (General Purpose AI). Je nach Einsatzbereich (HR, Leistungsbewertung, Zugang zu Dienstleistungen) können Hochrisiko-Anforderungen greifen. Die Pflicht zur KI-Kompetenz (AI Literacy) nach Art. 4 gilt seit Februar 2025.

- Drittlandtransfer: Microsoft verarbeitet Daten primär in der EU (EU Data Boundary), kann aber je nach Konfiguration Modelle und Infrastruktur außerhalb der EU einsetzen. Standardvertragsklauseln (SCCs) und Transfer Impact Assessments sind zu dokumentieren.

| Frage | Warum sie wichtig ist | Typische Rolle |

|---|---|---|

| Welche Datenklassen dürfen in welche KI-Schicht? | Personenbezogene, vertrauliche oder regulierte Daten brauchen andere Regeln als öffentliche Inhalte. | Datenschutz, Legal, IT Security |

| Sind Microsoft-365-Berechtigungen sauber? | Copilot kann vorhandene Fehlberechtigungen für mehr Nutzer sichtbar machen (Over-Sharing-Risiko). | IT, Fachbereiche |

| Welche Agenten dürfen schreiben oder handeln? | Antwort-KI und Aktions-KI haben unterschiedliche Risikoprofile und Haftungsfragen. | Prozessverantwortliche, Compliance |

| Wie wird der Betriebsrat eingebunden? | Nutzungsdaten und neue Arbeitsweisen können nach BetrVG §87 mitbestimmungspflichtig sein. | HR, Legal, Betriebsrat |

| Welche Schulung ist Pflicht? | Der EU AI Act verlangt seit Februar 2025 nachweisbare KI-Kompetenz (AI Literacy, Art. 4). | HR, Learning, Führung |

Grenzen und Risiken: Was Microsoft Copilot nicht löst

Kein KI-System – auch nicht Microsofts Portfolio – ist frei von Schwächen. Wer diese kennt, trifft bessere Rollout-Entscheidungen.

🔴 Bekannte Risiken und Grenzen

- Halluzinationen: Microsoft 365 Copilot kann sachlich falsche Antworten produzieren – besonders bei komplexen Faktenabfragen oder wenn der Graph-Kontext unvollständig ist. Menschliche Prüfung bleibt Pflicht.

- Over-Sharing durch Graph-Permissions: Copilot greift auf alle Inhalte zu, auf die ein Nutzer Rechte hat. Fehlkonfigurierte SharePoint- oder Teams-Berechtigungen werden durch Copilot sichtbarer und riskanter.

- Vendor Lock-in: Das gesamte Portfolio ist tief in das Microsoft-Ökosystem integriert. Ein späterer Wechsel zu alternativen Plattformen wird mit steigender Abhängigkeit aufwändiger.

- Kostentransparenz bei Agenten: Agentische Workflows und Token-basierte Abrechnung (Azure AI Foundry, GitHub Copilot ab Juni 2026) können bei intensiver Nutzung deutlich teurer werden als die Basislizenz vermuten lässt. Budgetkontrollen sind vor dem Rollout einzurichten.

- Qualität hängt von Datenhygiene ab: Copilot ist nur so gut wie die Daten und Metadaten im Microsoft 365-Tenant. Unvollständige oder veraltete Informationen in SharePoint oder Teams führen zu schlechteren Ergebnissen.

Praxisbeispiel: Mittelständischer Maschinenbauer

- Microsoft 365 Copilot für ausgewählte Wissensrollen: Vertrieb, Projektleitung und Management testen Copilot in Outlook, Teams, Word und PowerPoint – nach AVV-Abschluss und DSFA.

- GitHub Copilot für Entwicklungsteams: Entwickler nutzen Copilot Business (19 USD/Nutzer/Monat) in IDE und Pull-Request-Prozessen; Code Reviews, Security Scans und Lizenzprüfung bleiben manuell.

- Fachbereichsagent in Copilot Studio: HR baut einen Wissensagenten für interne Richtlinien mit klarer Eskalation und Betriebsratseinbindung nach BetrVG §87.

- Security Copilot im SOC: Das Security-Team testet Incident-Zusammenfassungen und KQL-Vorschläge – mit expliziter Festlegung, welche Aktionen nur Menschen ausführen dürfen.

- Agent 365 und Foundry für Skalierung: Sobald Agent 365 allgemein verfügbar ist (geplant H2 2026), werden Inventar, Agent-Identitäten, Logs, Verantwortliche und Not-Aus-Prozesse festgelegt.

Handlungsempfehlung: Der 90-Tage-Startplan

✅ Empfehlung

Starten Sie nicht mit der Frage, welche Copilot-Lizenz am besten klingt. Starten Sie mit Use Cases, Datenklassen, Rollen, Freigaben und messbaren Verbesserungen. Klären Sie AVV, DSFA, BetrVG und EU-AI-Act-Pflichten vorab. Danach wird entschieden, welcher Microsoft-KI-Baustein wirklich gebraucht wird.

| Zeitraum | Aufgabe | Ergebnis |

|---|---|---|

| Woche 1–2 | Portfolio-Scope klären + AVV/DPA prüfen | Relevante Microsoft-KI-Bausteine priorisieren; Datenschutzstatus klären |

| Woche 2–4 | Daten- und Rechtsprüfung + DSFA-Vorprüfung | Kritische SharePoint-, Teams-, OneDrive- und Dataverse-Bereiche identifizieren |

| Woche 3–5 | Use Cases priorisieren + Betriebsrat informieren | 3–5 Anwendungsfälle nach Nutzen, Risiko und Umsetzbarkeit auswählen |

| Woche 5–8 | Pilotgruppen starten | Schulung (inkl. AI Literacy nach EU AI Act Art. 4), Feedbackkanäle, Nutzungsregeln einrichten |

| Woche 8–10 | Agenten-Governance definieren | Rechte, Logging, Freigaben, Eskalationen und Abschaltregeln festlegen (Agent 365) |

| Woche 10–12 | Skalierungsentscheidung | Produktivität, Qualität, Risiko, Akzeptanz und Kosten bewerten; Budgetkontrollen prüfen |

FAQ

Ist Microsoft Copilot ein einzelnes Produkt?

Kurz: Nein. „Copilot" ist inzwischen eine Produktfamilie und eine Bedienlogik. Dazu gehören laut Microsoft: Microsoft 365 Copilot, Copilot Chat, Copilot Studio, Security Copilot, GitHub Copilot, Dynamics- und Fabric-Copilots sowie Copilot-Funktionen in Windows.

Was ist der Unterschied zwischen Copilot Studio und Azure AI Foundry?

Kurz: Zielgruppe, Tiefe und Kontrolle. Copilot Studio richtet sich an Fachanwender und Citizen Developer: Man wählt eine Wissensbasis (z. B. SharePoint-Dokumente oder eine FAQ-Datenbank), definiert Gesprächsabläufe und veröffentlicht den Agenten in Teams – ohne eine Zeile Code. Ein HR-Team, das einen Richtlinien-Bot baut, arbeitet typischerweise in Copilot Studio. Azure AI Foundry hingegen ist laut Microsoft die Plattform für Entwickler und KI-Architekten: Modellauswahl (GPT-4o, Phi, Llama und weitere), Fine-Tuning, Evaluation, CI/CD-Pipelines, eigene Vektordatenbanken und produktionsreife Deployment-Prozesse. Wer einen eigenen Agenten mit Unternehmensdaten und Custom Logic bauen will, der über Copilot Studio hinausgeht, arbeitet in Foundry.

Warum ist Agent 365 wichtig – und wann ist es verfügbar?

Kurz: Kontrolle über viele Agenten – geplant für H2 2026. Laut Microsoft-Ankündigung befindet sich Agent 365 (Stand Mai 2026) in der schrittweisen Einführung für Enterprise-Kunden; die breite Verfügbarkeit ist für das zweite Halbjahr 2026 geplant. Unternehmen brauchen dann ein zentrales Inventar, Identitäten, Zugriffskontrollen, Logs, Richtlinien und Lebenszyklusmanagement – insbesondere wenn Agenten eigenständig handeln dürfen.

Brauche ich eine Datenschutz-Folgenabschätzung für Copilot?

Kurz: Sehr wahrscheinlich ja. Bei großflächigem Einsatz mit Zugriff auf personenbezogene Daten – insbesondere durch agentische Funktionen – ist eine DSFA nach Art. 35 DSGVO sehr wahrscheinlich erforderlich. Sprechen Sie mit Ihrem Datenschutzbeauftragten, bevor Sie mit dem Rollout beginnen.

Was sollten DACH-Unternehmen vor einem Rollout prüfen?

Kurz: Sieben Punkte. Datenklassen und Berechtigungen, AVV/DPA-Unterlagen (Art. 28 DSGVO), DSFA-Pflicht (Art. 35 DSGVO), Drittlandtransfer und SCCs, Betriebsratseinbindung (BetrVG §87), AI-Literacy-Nachweis (EU AI Act Art. 4) sowie Logging, Kostenmodell und menschliche Freigaben für Agenten.

Fazit

Microsofts KI-Portfolio 2026 ist kein einzelner Assistent, sondern eine Unternehmensschicht. Wer es strategisch nutzen will, braucht mehr als Lizenzen: eine klare Datenarchitektur, Berechtigungsmanagement, Compliance-Dokumentation und ein realistisches Bild der Kosten – inklusive Governance, Schulung und Betriebsrat. Die gute Nachricht: Die Bausteine sind vorhanden. Die Arbeit liegt in der Architektur, nicht im Einkauf.

📬 DACH-Enterprise-KI wöchentlich

Compliance, Governance und KI-Strategie für IT-Entscheider direkt ins Postfach – jede Woche kompakt. Jetzt den AI-Fabrik Newsletter abonnieren →

Quellen

- Microsoft Learn: Microsoft 365 Copilot overview, abgerufen am 6. Mai 2026.

- Microsoft Learn: Enterprise data protection in Microsoft 365 Copilot, abgerufen am 6. Mai 2026.

- Microsoft: Microsoft 365 Copilot Preise, abgerufen am 6. Mai 2026.

- Microsoft: Microsoft Copilot Studio, abgerufen am 6. Mai 2026.

- Microsoft: Microsoft Agent 365, abgerufen am 6. Mai 2026.

- Microsoft Azure: Microsoft Foundry, abgerufen am 6. Mai 2026.

- GitHub Docs: Pläne für GitHub Copilot, abgerufen am 6. Mai 2026.

- GitHub Blog: Nutzungsbasierte Abrechnung für Copilot ab 1. Juni 2026 (AI Credits), abgerufen am 6. Mai 2026.

- Microsoft Learn: What is Microsoft Security Copilot?, abgerufen am 6. Mai 2026.

- EU AI Act, Art. 4 (AI Literacy), Art. 6 und Anhang III (Hochrisiko-KI), in Kraft seit Februar 2025.

- DSGVO, Art. 28 (Auftragsverarbeitung), Art. 35 (Datenschutz-Folgenabschätzung).

- BetrVG §87 (Mitbestimmung bei technischen Einrichtungen).

Weiterführende Artikel:

→ Googles KI-Portfolio 2026: Gemini Enterprise, Vertex AI, Agent Builder und Workspace im Überblick

→ Generative AI, Agentic AI und AI Agents: Der Unterschied einfach erklärt

→ Codex für Einsteiger: 3 Use Cases, mit denen Anwender sofort starten können