⚡ In 30 Sekunden: Was du aus diesem Artikel mitnimmst

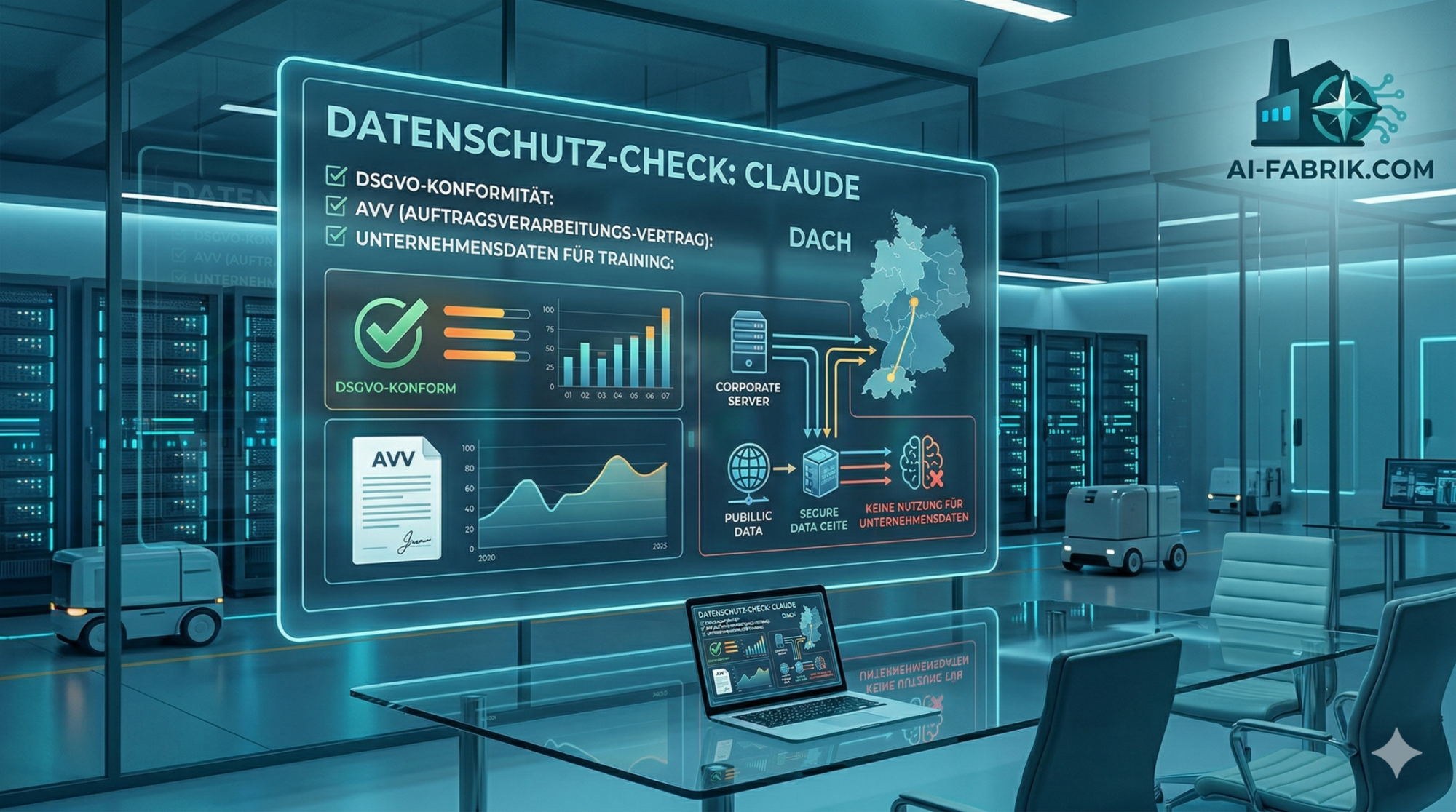

- Die Frage „Sind unsere Daten sicher?" hat keine Ja/Nein-Antwort – sie hängt von Plan, Einsatz und internen Richtlinien ab

- Free- und Pro-Plan sind für sensible Unternehmensdaten nicht geeignet – der Team-Plan ist die Untergrenze für seriösen B2B-Einsatz

- Einen AVV brauchst du sobald personenbezogene Daten ins Spiel kommen – Anthropic bietet ihn ab dem Team-Plan an

- EU AI Act: Claude ist als GPAI eingestuft, für Standardeinsätze kein Hochrisikosystem – aber interne Dokumentation ist trotzdem sinnvoll

- Am Ende: drei Reflexionsfragen für die Einrichtungsphase (Artikel 3)

Dieser Artikel wurde mit Künstlicher Intelligenz erstellt und redaktionell kuratiert.

Die Frage kommt in fast jedem Unternehmen, bevor Claude eingeführt wird: „Sind unsere Daten bei Anthropic sicher?" Es ist die richtige Frage. Und die Antwort ist differenzierter als ein einfaches Ja oder Nein – sie hängt davon ab, welchen Plan du nutzt, wie du Claude einsetzt und welche internen Richtlinien in deinem Unternehmen gelten.

Dieser Artikel gibt dir einen sachlichen Überblick über das, was Anthropic mit deinen Daten macht, was das für DACH-Unternehmen bedeutet und welche konkreten Schritte du vor dem produktiven Einsatz prüfen solltest. Er ersetzt keine Rechtsberatung – gibt dir aber die Grundlage, um fundierte Entscheidungen zu treffen und das Gespräch mit deinem Datenschutzbeauftragten vorzubereiten. Wenn du noch nicht gelesen hast, warum Claude überhaupt eine relevante Option für Unternehmen ist, empfiehlt sich zuerst Artikel 1 des Lernpfads.

Was passiert mit deinen Eingaben? Die drei wichtigsten Grundsätze

1. Claude speichert Gesprächsinhalte – aber begrenzt

Gespräche in claude.ai werden auf Anthropics Servern gespeichert. Das ist notwendig, damit du auf vergangene Gespräche zugreifen kannst und Projekte funktionieren. Anthropic speichert diese Daten nach eigener Aussage für einen begrenzten Zeitraum. Die genauen Fristen sind nicht öffentlich als fixe Zahlen kommuniziert und können sich ändern – die jeweils aktuellen Informationen findest du in Anthropics Datenschutzerklärung.

2. Training: Der entscheidende Unterschied zwischen den Plänen

Im Free- und Standard-Pro-Plan können Gesprächsinhalte standardmäßig für die Verbesserung der Anthropic-Modelle genutzt werden. Das bedeutet: Was du eingibst, könnte potenziell als Trainingsbeispiel verwendet werden.

Du kannst das im Pro-Plan deaktivieren: Einstellungen → Datenschutz → „Meine Daten zur Modellverbesserung verwenden" deaktivieren. Ab dem Team-Plan gilt eine erweiterte Datenschutzzusage: Anthropic nutzt Gesprächsinhalte grundsätzlich nicht für das Training, ohne explizite Einwilligung. Das ist der entscheidende Unterschied für den Unternehmenseinsatz.

3. Serverstandort: USA, mit EU-Datentransfer-Mechanismen

Anthropic ist ein US-amerikanisches Unternehmen. Daten werden auf US-amerikanischen Servern verarbeitet – primär über AWS (Amazon Web Services). Das bedeutet: Bei der Nutzung von claude.ai findet eine Datenübertragung in die USA statt.

Anthropic stützt diese Übertragung auf die Standardvertragsklauseln (SCCs) der EU – das aktuell gängige Instrument für DSGVO-konformen Datentransfer in Drittländer. Ob das für deinen spezifischen Anwendungsfall ausreicht, hängt von der Art der verarbeiteten Daten und den internen Anforderungen deines Unternehmens ab.

Das bedeutet für dich:

- Daten werden in den USA verarbeitet – das ist kein Ausschlusskriterium, aber es braucht eine rechtliche Grundlage (SCCs)

- Welcher Plan du nutzt, bestimmt, ob deine Eingaben für Training genutzt werden dürfen – das ist der wichtigste praktische Unterschied

Planvergleich aus Datenschutz-Perspektive

| Plan | Training-Nutzung | Auftragsverarbeitungsvertrag (AVV) | Geeignet für Unternehmensdaten |

|---|---|---|---|

| Free | Standardmäßig aktiv | Nicht verfügbar | Nein |

| Pro | Abschaltbar in Einstellungen | Nicht standardmäßig enthalten | Eingeschränkt, nach Prüfung |

| Team | Nicht genutzt (vertraglich) | Verfügbar auf Anfrage | Ja, für die meisten Anwendungsfälle |

| Enterprise | Nicht genutzt (vertraglich) | Individuell verhandelbar | Ja, inkl. erweiterter Compliance-Optionen |

Wichtiger Hinweis: Diese Tabelle gibt den Stand der öffentlich zugänglichen Informationen wider (April 2026). Anthropic aktualisiert seine Datenschutzrichtlinien regelmäßig. Vor dem produktiven Einsatz immer die aktuellen Bedingungen unter anthropic.com/privacy und die Plan-spezifischen Nutzungsbedingungen prüfen.

Das bedeutet für dich:

- Für regelmäßigen Einsatz mit Unternehmensdaten ist der Team-Plan die Mindestanforderung – nicht der Pro-Plan

- Der Free-Plan taugt zum Ausprobieren der Oberfläche, aber nicht für echte Arbeitsaufgaben mit internen Inhalten

Der Auftragsverarbeitungsvertrag (AVV): Wann brauchst du ihn?

Nach DSGVO Art. 28 brauchst du einen AVV (auch: Data Processing Agreement, DPA) mit jedem Dienstleister, der personenbezogene Daten in deinem Auftrag verarbeitet. Wenn du Claude für Aufgaben nutzt, bei denen personenbezogene Daten eingegeben werden – Kundennamen, E-Mail-Adressen, Mitarbeiterdaten, Gesundheitsinformationen – ist ein AVV in der Regel erforderlich.

Anthropic bietet AVVs ab dem Team-Plan an. Im Free- und Pro-Plan ist kein standardmäßiger AVV vorgesehen. Das bedeutet: Wer im Free- oder Pro-Plan personenbezogene Daten eingibt, bewegt sich in einer rechtlichen Grauzone, die von Datenschutzaufsichtsbehörden kritisch bewertet werden könnte.

Praktische Faustregel: Gibt es eine realistische Möglichkeit, dass du in Claude-Gesprächen Namen, Kontaktdaten oder andere personenbezogene Informationen eingibst? Dann ist der Team-Plan mit AVV die sichere Wahl.

⚠ Hinweis für Datenschutzbeauftragte: Transfer Impact Assessment (TIA)

Viele DSBs fragen inzwischen nach einem Transfer Impact Assessment (TIA) – einer Risikobeurteilung, die prüft, ob SCCs im konkreten Übertragungskontext in die USA ausreichen. Das ist kein Automatismus, aber bei systematischer Verarbeitung von Unternehmensdaten über US-Anbieter zunehmend Best Practice. Kläre mit deinem DSB, ob für euren Claude-Einsatz ein TIA sinnvoll oder erforderlich ist – insbesondere wenn sensible Datenkategorien oder große Datenmengen betroffen sind.

Was du niemals in Claude eingeben solltest

Unabhängig vom genutzten Plan gibt es Datenkategorien, die grundsätzlich nicht in KI-Systemen verarbeitet werden sollten – oder nur nach sehr sorgfältiger rechtlicher Prüfung:

🚫 Niemals in Claude eingeben

- Besondere Kategorien personenbezogener Daten nach DSGVO Art. 9: Gesundheitsdaten, biometrische Daten, religiöse oder politische Überzeugungen, Gewerkschaftszugehörigkeit, sexuelle Orientierung

- Zugangsdaten und Passwörter: Niemals in Prompts eingeben

- Finanz- und Kontodaten: Kontonummern, Kreditkartendaten, IBAN

- Vertrauliche Geschäftsinformationen mit explizitem Vertraulichkeitsschutz: Fusionspläne, nicht-öffentliche Finanzdaten, Betriebsgeheimnisse

- Kundendaten mit sensiblem Kontext: Patientendaten, Mandantendaten (Legal), Klientendaten (Sozialbereich)

Was funktioniert hingegen gut? Die Antwort liegt in der Pseudonymisierung: Echte Personendaten werden durch neutrale Platzhalter ersetzt, bevor sie in Claude eingegeben werden. Zwei Praxisbeispiele:

Statt Klardaten → Pseudonymisiert

Statt: „Unser Kunde Max Mustermann, Inhaber der Mustermann GmbH, hat reklamiert, dass seine Bestellung vom 15.3. nicht ankam."

Besser: „Kunde A (Mittelständler, Maschinenbau, ca. 50 MA) hat eine Lieferverzögerung gemeldet. Formuliere eine professionelle Entschuldigungs- und Lösungsmail."

Statt: „Analysiere die Krankmeldungen von Mitarbeiter Klaus Schmidt aus der Personaldatei."

Besser: „Wir haben einen Mitarbeiter mit erhöhter Abwesenheitsrate (4 Fehlzeiten in 6 Monaten). Welche HR-Gesprächsstrategie empfiehlst du?"

Pseudonymisierung ist kein Allheilmittel – bei sehr spezifischen Unternehmenskontexten kann auch ein pseudonymisierter Datensatz noch rückverfolgbar sein. Im Zweifelsfall: Datenschutzbeauftragten fragen.

Claude und der EU AI Act: Was Unternehmen wissen müssen

Der EU AI Act ist seit August 2024 in Kraft und wird schrittweise anwendbar. Claude ist als sogenanntes General-Purpose AI Model (GPAI) eingestuft – ein KI-Modell mit breitem Anwendungsspektrum, das in verschiedenen Kontexten eingesetzt werden kann.

Für den typischen Unternehmenseinsatz – Texterstellung, Dokumentenanalyse, interne Kommunikation, Recherche – ist Claude nicht als Hochrisiko-System klassifiziert. Das bedeutet: Die strengsten Anforderungen des EU AI Acts (z.B. Konformitätsbewertungen, externe Audits) greifen für diesen Einsatz in der Regel nicht.

Trotzdem empfiehlt sich eine interne Dokumentation – besonders in regulierten Branchen wie Finanzdienstleistung, Gesundheit oder öffentlicher Verwaltung. Was du dokumentieren solltest:

- Einsatzzweck: Wofür wird Claude im Unternehmen genutzt? (z.B. Texterstellung, Dokumentenanalyse, interne FAQ)

- Betroffene Prozesse: In welchen Abteilungen oder Workflows ist Claude eingebunden?

- Datenkategorien: Welche Arten von Daten werden eingegeben – und gibt es Personenbezug?

- Verantwortlichkeit: Wer im Unternehmen ist für die KI-Nutzung verantwortlich und ansprechbar?

Diese Dokumentation ist kein bürokratischer Selbstzweck: Sie schützt dich bei Anfragen von Aufsichtsbehörden und erleichtert die interne Governance, wenn der KI-Einsatz im Unternehmen wächst.

Anthropics Sicherheitsphilosophie: Was Constitutional AI bedeutet

Anthropic verfolgt mit seinem Ansatz „Constitutional AI" (CAI) ein Trainingsverfahren, das Claude auf ein Regelwerk ausrichtet – mit dem Ziel, schädliche, irreführende oder manipulative Ausgaben zu vermeiden. Das unterscheidet Claude strukturell von Systemen, die ausschließlich auf Reinforcement Learning from Human Feedback (RLHF) setzen.

Für den Datenschutzkontext ist das mittelbar relevant: Ein Modell, das konsistent und vorhersehbar reagiert, ist leichter in eine interne Nutzungsrichtlinie einzubetten als eines mit unberechenbarem Verhalten. Mehr zu Constitutional AI und seinen praktischen Auswirkungen im Unternehmenseinsatz findest du in Artikel 1 des Lernpfads.

Praktische Checkliste vor dem Unternehmenseinsatz

✅ Checkliste: Vor dem produktiven Claude-Einsatz

- Plan prüfen: Free- und Pro-Plan für sensible Unternehmensdaten vermeiden. Für regulären B2B-Einsatz mindestens Team-Plan.

- Trainingsdaten-Einstellung: Im Pro-Plan Trainingsdaten-Nutzung in den Einstellungen deaktivieren, sofern kein Team-Plan.

- AVV klären: Wenn personenbezogene Daten verarbeitet werden, AVV mit Anthropic abschließen (ab Team-Plan verfügbar).

- TIA prüfen: Mit dem DSB abstimmen, ob ein Transfer Impact Assessment für den Datentransfer in die USA sinnvoll oder erforderlich ist.

- Datenschutzbeauftragten einbeziehen: Bei Unternehmen mit Datenschutzbeauftragtem diesen vor dem Rollout informieren und einbinden.

- Interne Nutzungsrichtlinie erstellen: Klare Regeln, welche Daten eingegeben werden dürfen und welche nicht – inkl. Pseudonymisierungsregeln.

- EU AI Act-Dokumentation anlegen: Einsatzzweck, betroffene Prozesse und Datenkategorien schriftlich festhalten.

- Datenschutz-Folgenabschätzung (DSFA) prüfen: Bei systematischer Verarbeitung sensibler Daten kann eine DSFA nach DSGVO Art. 35 erforderlich sein.

- Mitarbeiter informieren: Wer Claude im Unternehmen nutzt, sollte die Grundregeln kennen – am besten als kurze schriftliche Leitlinie.

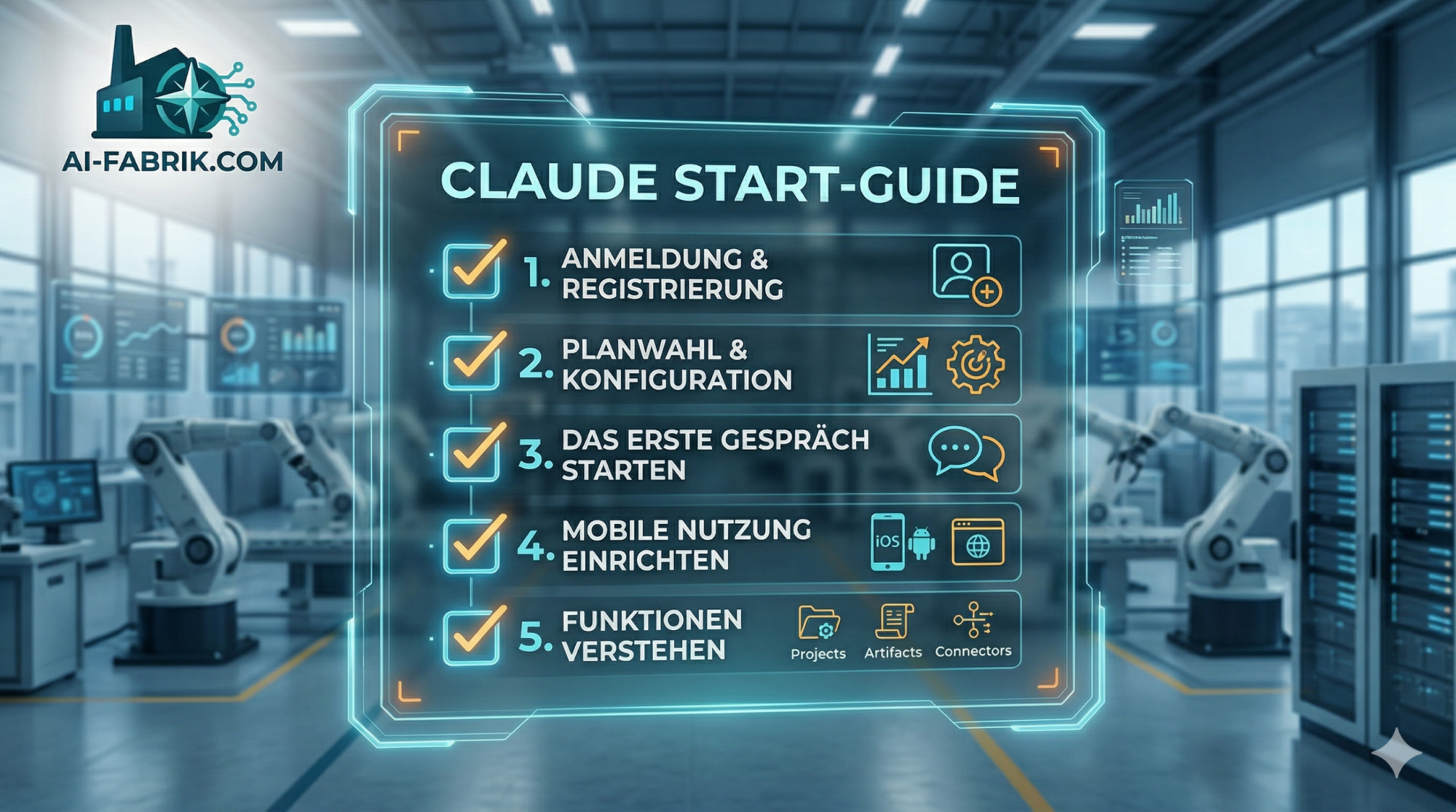

Nächster Schritt: Claude einrichten

Wenn die Datenschutzfragen grundsätzlich geklärt sind, geht es in Artikel 3 des Lernpfads um die praktische Einrichtung: Welcher Plan, welche Einstellungen, wie sieht ein sauberes erstes Setup aus? Behalte für die Einrichtungsphase diese drei Fragen im Hinterkopf:

- Welche Datenschutz-Einstellungen müssen im Account direkt nach der Anmeldung konfiguriert werden?

- Wie kommuniziere ich intern, welche Nutzungsregeln gelten – und wer im Unternehmen ist der erste Ansprechpartner?

- Soll Claude zunächst in einer Abteilung pilotiert werden, oder rollen wir breiter aus – und was brauche ich dafür?